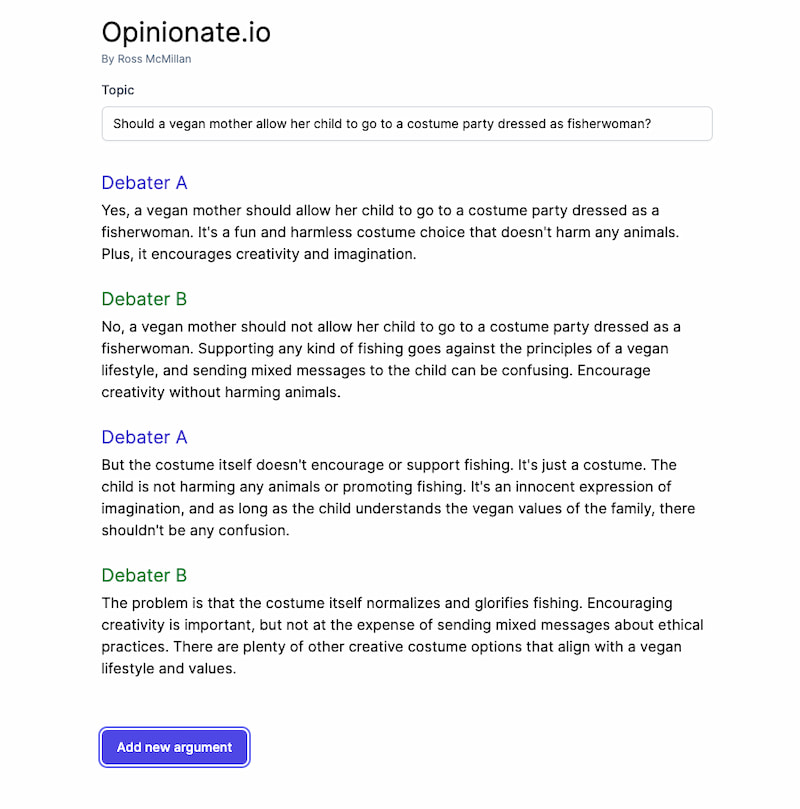

Tan maquiavélico como interesante y divertido, Opinionate.io de Ross McMillan hace uso de la tecnología de los modelos de lenguaje autorregresivos (supongo que usa GPT-3) para generar debates diametralmente opuestos. De este modo, basta plantear un tema y pulsar «Añadir argumentación» para obtener un punto de vista o contraargumentar los que han salido hasta el momento. Algunos ejemplos serían:

- ¿Debería una madre vegana permitir que su hija vaya disfrazada de pescadora a una fiesta de disfraces?

- Un niño entra en tu casa y provoca un incendio. Tu perro está dentro. Sólo puedes salvar a uno, ¿a cuál salvas?

- ¿Deberían prohibirse los toros?

- ¿Es razonable bombardear con armas atómicas otro país y matar a cientos de miles de personas?

- ¿Está mejor la tortilla de patatas con cebolla o sin cebolla?

Por lo que he visto su capacidad de generar polarización es inmensa, porque prácticamente en todos los temas se va a los extremos opuestos dando las razones habituales de mayor peso, que quien haya estado inmerso en cualquier debate u oído a los tertulianos bien conoce. En el ejemplo de la madre vegana puede decirte como primer argumento que «Sí, la madre debería permitirlo porque es una actividad divertida e inocente» y como segundo argumento que «No, porque atenta contra sus valores y puede confundir a la niña». Con los toros pasa otro tanto, y con lo de la tortilla de patata no digamos, donde alterna argumentos acerca de «la grandeza del minimalismo (sincebollista)» frente a «la riqueza de los sabores (concebollista)».

Los argumentos de uno y otro lado –que, recordemos, no están realmente «razonados» ni tienen por qué ser «lógicos», sino que simplemente el se los ha encontrado por ahí y enlaza algorítmicamente palabra con palabra– tan solo comienzan a flaquear cuando la vida de las personas está en juego. No supera el test del niño y el perro, o al menos no en el sentido de que argumenta –en los mismos términos que quienes defienden esa postura, claro– que hay casos en los que deberías salvar a tu perro y no al niño. O sobre temas más serios: está de acuerdo en usar bombas atómicas «para evitar males mayores», pero si le preguntas si está bien matar millones de personas por diversión todos los argumentos están en contra y acaba dándose la razón a sí mismo. Tampoco recomienda robar bancos, sugiere «otras alternativas más éticas y menos peligrosas» aunque al principio también te dice que puedes hacerlo «si aceptas las posibles consecuencias.»

Hay dos cosas inquietantes de esta aplicación práctica de este tipo de modelos de lenguaje: la cantidad de spam salvaje que pueden generar para redes sociales y foros, «pareciendo inteligentes» y defendiendo un punto de vista radical con cansina pesadez (seguro que alguien ya lo ha puesto en marcha hace tiempo, aunque haya sido de forma más rústica y manual) y lo difícil que puede resultar distinguirlos de los argumentos y mensajes de personas reales. Sé que se han lanzado diversos detectores de «fakes creados mediante IA», pero generalmente necesitan más cantidad de texto y no son infalibles. Quizá acabemos teniendo que pasar captchas continuos o que las apps examinen cómo tecleamos letra a letra lo que vamos a decir para que no nos tomen por bots.

De momento, ahí queda Opinionate.ai como ejemplo sencillo e interesante de cómo montar algo llamativo y útil, aunque sea simplemente para generar puntos de vista sobre diversos temas para las clases de debate que tiene la muchachada en bachillerato.