Este artículo se publicó originalmente en Cooking Ideas, un blog de Vodafone donde colaboramos semanalmente.

La pantalla táctil es la tecnología es el método de interacción que cada vez más utilizamos con todo tipo de dispositivos electrónicos. Es habitual encontrarlas en teléfonos móviles, tablets e incluso ordenadores, pero también se están popularizando entre dispositivos de todo tipo, como cámaras de fotos.

Las pantallas táctiles más comunes son capacitivas —funcionan al contacto y no por la presión del dedo u otro objeto, como un puntero— y son capaces de detectar múltiples contactos simultáneamente (multi contacto), incluso diez o más.

Pero más allá de esto en los últimos años la pantalla táctil ha recibido pocas innovaciones más, o al menos las novedades de momento apenas se aplican de forma masiva.

Un ejemplo que sirve casi a modo de excepción es la pantalla del Sony Xperia Sola con pantalla FloatingTouch. Esta pantalla detecta el dedo del usuario aunque éste no haga contacto físico con la superficie.

De modo que esta pantalla añade una tercera dimensión a la superficie táctil, lo que permite recuperar una práctica de interacción habitual de los ordenadores, muy familiar para los usuarios: colocar el puntero del ratón sobre enlaces u objetos.

Así al mover el dedo sobre la pantalla, manteniéndolo a unos pocos milímetros de distancia, aparece un puntero similar al de los ratones que puede desplegar un menú contextual, cambiar el color de un enlace o la apariencia de una imagen o mostrar información adicional. Y al hacer contacto físico se ejecuta la acción similar a un clic con el ratón.

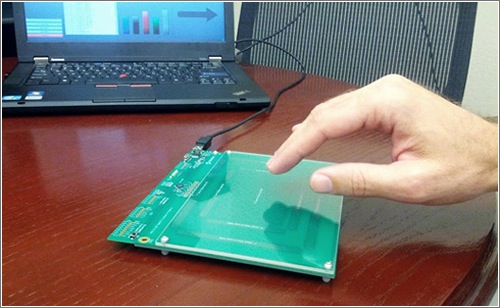

Algo parecido es la tecnología que está desarrollando la compañía Microchip Technology. Se trata de una evolución de la capa sensible al tacto utilizada hasta ahora que amplía el espacio disponible por el usuario para hacer gestos en un espacio tridimensional.

De este modo el dispositivo es capaz de reconocer y responder a gestos más complejos que los que se limitan a deplazar los dedos por la pantalla. El resultado es un control similar al que ahora se logra mediante cámaras, caso del control Kinect de la Xbox citando un ejemplo más que conocido; también se logra actualmente utilizando la cámara frontal del teléfono móvil, que si bien ofrece ciertas posibilidades funciona de forma limitada y supone un gran consumo de batería.

Esta tecnología funciona detectando y distinguiendo perturbaciones en un campo eléctrico generado sobre la superficie táctil. El resultado es similar a la utilizada por sensor de gestos Lead Motion. Aunque de momento el de Microchip Technology resulta menos preciso y su alcance más limitado, ofreciendo un espacio relativamente pequeño en el que gesticular, hasta unos 18 cm de distancia sobre la superficie táctil.

Más allá de la pantalla

Mientras tantos los fabricantes de dispositivos móviles buscan constantemente nuevas formas de aumentar la interacción con sus dispositivos más allá de la pantalla táctil, utilizando cámaras, micrófonos y sensores de movimiento o de proximidad.

Algunas de estas nuevas formas de interacción son relativamente comunes en los smartphones. Por ejemplo, marcas como HTC o Samsung utilizan el sensor de movimiento para silenciar el teléfono si se les da la vuelta. O para activar alguna función —como iniciar una llamada— cuándo éste se levanta para llevarlo a la oreja.

Estos sensores, por sí solos o en combinación con otros, también consiguen que los teléfonos móviles distingan si están guardados en el bolsillo o si están en la mano del usuario, y en función de ellos variar el volumen del timbre o activar la vibración, por ejemplo.

Las cámaras frontales sirven también como método de entrada de información para el teléfono, captando gestos de control del usuario o detectando si éste está mirando el teléfono, y en caso de ser así no poner el teléfono en reposo.

El micrófono también se puede utilizar para ampliar las posibilidades de interacción, en combinación o no con la pantalla táctil. Las órdenes de voz o la interacción conversacional con el teléfono —en la que el usuario ordena tareas de forma hablada— sería un ejemplo evidente. Aunque también el micrófono se puede utilizar para detectar cuándo el usuario está tocando la pantalla con distintas partes de la mano (uñas, nudillos) o un objeto, y actuar de forma adicional al contacto convencional.

El sensor de proximidad, normalmente utilizado para bloquear la pantalla cuando el usuario acerca el teléfono a la oreja —y de este modo evitar acciones no deseadas durante la conversación— también puede cumplir funciones adicionales: el teléfono puede saber si se encuentra guardado, en la funda. O puede mostrar información —como la hora y las últimas notificaciones— cuando el usuario acerque la mano, sin necesidad de tocar el teléfono.