Este artículo se publicó originalmente en Cooking Ideas, un blog de Vodafone donde colaboramos semanalmente con el objetivo de crear historias que «alimenten la mente de ideas».

Inteligencia artificial. Superinteligencia. Futuro inabarcable. Cambio exponencial. Aceleración del conocimiento. Evento histórico. Transhumanismo. Son algunos términos que, si bien no definen exactamente, ayudan a hacerse una idea de lo que significa la singularidad tecnológica. El término no es nuevo y fue acuñado por el matemático y novelista Vernor Vinge en 1982 y popularizado posteriormente por otros autores de la la ciencia ficción como él. Como resumió Bill Gates, es «una forma optimista y radical de ver el futuro del desarrollo humano».

La idea es tan compleja que existen libros y libros sobre ella, además de innumerables menciones y referencias con ese y otro nombre en miles de imaginativas novelas sobre el lejano futuro. En física y matemáticas los conceptos de singularidad son bien conocidos. Al trabajar con números y funciones, surgen por ejemplo cuando se divide por cero (y el resultado tiende a infinito). En física, aparecen las singularidades en los agujeros negros de las profundidades del espacio, donde suceden cosas tan extrañas como que dentro de ellos no se pueden definir las magnitudes físicas de los objetos ni del espacio mismo o la gravedad: las leyes de la física convencional simplemente no sirven ahí.

Con la singularidad tecnológica sucede algo parecido: se refiere a una evolución tan poderosa de la tecnología que llega a un punto, esa mítica singularidad, en que simplemente «tiende a infinito»; un momento en el que el desarrollo de la inteligencia artificial supera a la de los humanos y comienza por extensión a «superarse a sí misma», en una especie de bucle sin fin, creando nuevas máquinas más y más inteligentes cada vez, disparándose y creciendo de forma exponencial.

En muchas ocasiones esta singularidad tecnológica se une a una especie de transhumanismo: el momento en que los seres humanos y las máquinas nos combinaremos unos con otros, ampliando la capacidad de nuestros cuerpos con tecnología, pareciéndonos más a esas poderosas máquinas. En otras versiones, son las redes de máquinas las que, cual la Skynet de Terminator, cobran conciencia y se vuelven inteligentes como si los ordenadores de sus nodos comportaran a modo de neuronas humanas. Finalmente, en otras variantes, son los desarrollos en genética los que nos permiten a los humanos superar nuestras limitaciones cerebrales para volvernos «superinteligentes» entrando a partir de ese momento en un nuevo ciclo de creación de más y más inteligencia.

El truco –o lo complicado, según se mire– es llegar al punto mágico de la singularidad y conseguir que los «bucles hasta el infinito» funcionen. Reconozcámoslo: de momento las máquinas y programas inteligentes que hemos desarrollado los seres humanos son bastante torpes. Cierto es que pueden ganarnos al ajedrez, ser imbatibles a las damas y hacernos pasar un mal trago si son nuestros oponentes al póker. Reconocen caras, pueden simular la voz humana y reconocen malamente nuestros comandos de voz. Pero ni siquiera esas nimias tareas, aun consideradas genuinamente «de inteligencia» (aunque en realidad no lo sean tanto) palidecen ante complicaciones como una partida de Go, por poner un ejemplo sencillo, o para discernir la conversación de una voz en una bulliciosa fiesta o reconocer la cara de una madre. Como para superarnos a los humanos en la creación de una obra de teatro, un discurso o una sinfonía.

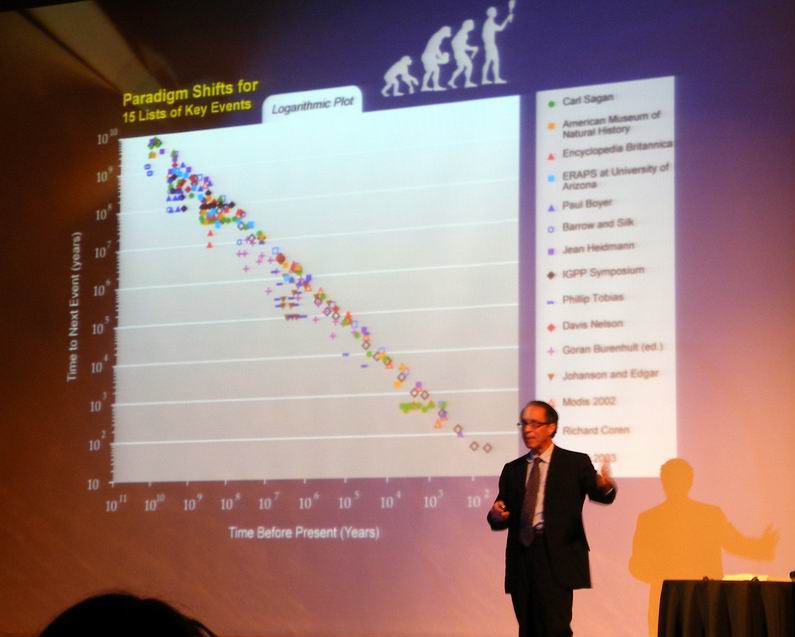

Quienes proponen la singularidad tecnológica como un punto al que inevitablemente hemos de llegar como raza en algún momento del cercano futuro –algunos dicen que tan pronto como en unas pocas décadas– exponen todo tipo de gráficos que muestran el desarrollo exponencial de un montón de aspectos de nuestra evolución: la capacidad de nuestros cerebros; nuestras habilidades como homo sapiens; la potencia de los ordenadores, que se multiplica cada pocos meses mientras se reduce a la mitad su precio (Ley de Moore mediante); la evolución de la economía; la cantidad de patentes que se registran; nuestra capacidad de analizar el genoma humano; los detalles que conocemos sobre nuestro cerebro…

Raymond Kurzweil, un inventor y experto en inteligencia artificial y tecnología, es uno de sus principales defensores y popularizadores. En sus libros La era de las máquinas inteligentes (1990) y La singularidad está cerca (1999) expuso todas sus ideas y teorías, con predicciones que en muchos casos resultaron acertadas, aunque muchas otras están todavía por comprobarse o han fallado.

Ray Kurzweil y Douglas Hofstaeder, frente a frente en Stanford (2006)

Foto (CC) Null0

Los detractores de las teorías de Kurzweil, entre los que están el científico y también experto en inteligencia artificial Douglas Hofstaeder critican las diversas teorías relacionadas con la singularidad puramente tecnológica en varios frentes. Muchos creen que una inteligencia artificial nunca podrá superar a una inteligencia humana. Otros creen que progresos como los de miniaturización y aceleración de los microprocesadores se enfrentarán a límites absolutos, tales como que no es posible hacer circuitos más pequeños que el tamaño de los átomos.

Otras de las críticas apuntan al método empleado y a las observaciones realizadas: lo que parecen curvas de crecimiento exponencial en algunos terrenos (ej. la velocidad de los ordenadores, la población mundial) pueden no serlo en realidad, o serlo durante un periodo determinado pero no para siempre. Todo esto siembra un montón de dudas sobre que algún día se llegue realmente a alcanzar la singularidad tecnológica, por no hablar de lo complicado que sería ver realizadas el resto de teorías sobre máquinas y humanos, transhumanismo y demás, que todavía estarían muy lejos de nuestra capacidad.

¿Sería interesante que las teorías sobre la singularidad tecnológicas fueran correctas? ¿Qué haríamos si viéramos que realmente ya está a la vuelta de la esquina? ¿Queremos que la singularidad se produzca? ¿O acaso podríamos evitarlo? Aunque de momento parece que son unas ideas que encajan más con las novelas de ciencia ficción que con el desarrollo tecnológico y científico, no se puede negar que sirven para dejar volar la imaginación y soñar sobre un mundo futuro y «positivo» en el que los humanos somos algo más que humanos: seres superinteligentes –signifique lo que signifique eso… para bien o para mal–. De momento, habrá que esperar… por ejemplo echándole una partidita de ajedrez al ordenador, a ver si hay suerte y no nos gana esta vez.

{Foto (CC) Arenamontanus @ Flickr}

Relacionado:

- Thinkism: una crítica a la Singularidad, por Kevin Kelly

- Ordenadores más y más rápidos, hasta el infinito (o más allá)

- ¿Podría superar Google el test de Turing? Sería un buen presagio

- El Sistema de Computación Cuántica Orion, un fallido invento futurista

- Un futuro sin preocupaciones, la mejor parte de la Singularidad ;-)