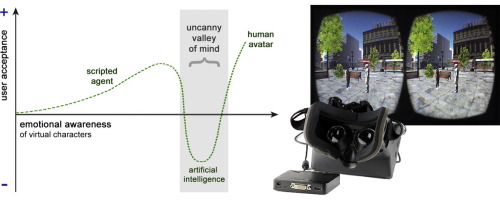

Un artículo titulado con el intrigante título Venturing into the uncanny valley of mind (Aventurándose en el valle inquietante de la mente) explica un experimento que se ha llevado a cabo respecto a cómo las personas percibimos la «humanidad» de las inteligencias artificiales dependiendo de cómo nos comuniquemos con ellas y lo que sepamos previamente que son realmente.

Utilizando un mundo virtual 3D los participantes tenían que interactuar con avatares, algunos de los cuales eran operadores humanos, otros inteligencias artificiales más o menos avezadas en su capacidad de comunicación y conocimientos. Además de esto a veces se le decía a los participantes previamente si iban a hablar con un ser humano o con una inteligencia artificial, y luego se examinaban sus sensaciones al respecto.

Los resultados sugieren que a los humanos nos resulta inquietante y desagradable tratar con ordenadores «demasiado humanos», pero también que tenemos esa misma sensación cuando hablamos con humanos que «siguen un guión fijo» (se me ocurre el ejemplo de los teleoperadores). Ambos casos son muy distintos de tratar con una inteligencia artificial que sabemos de antemano que está limitada como tal o con un ser humano empático normal y corriente. De hecho dicen que probablemente la empatía y nuestra capacidad de reconocer la humanidad en otros seres (sin necesidad de verlos, o independientemente de su aspecto) es lo que nos hace más humanos.

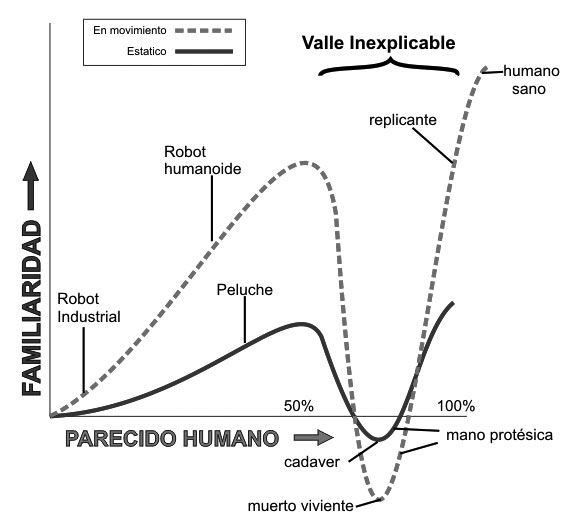

La teoría del valle inquietante (o inexplicable, como también se le llama) proviene de 1970, cuando se analizaron las reacciones de las personas ante el aspecto físico de los robots: nos resulta indiferente o agradable que un robot se parezca a un humano, pero superado cierto punto, el parecido es demasiado real cuando nos consta (por el aspecto o las respuestas que ofrece) que es un ser mecánico – o un software, como en este caso.

En Inverse cuentan que las sensaciones de los participantes en estos experimentos verbales –donde se intentaba evitar el aspecto físico y visual– acababan en descripciones como «son humanos sin sentimientos» o «parecen zombis filosóficos» para referirse a las inteligencias artificiales, aun en casos en los que sus respuestas eran verbalmente idénticas simplemente porque no se les decía que había personas detrás.

También menciona que el famoso valle sigue siendo un problema para que las ventas de robots aumenten en ciertos sectores. Quizá por razones similares a las del rechazo de los participantes en el estudio, que se citan sensaciones como «sentirse amenazado por la existencia de los robots» o considerar que «el ámbito de las emociones es un privilegio exclusivamente humano». Más vale que nos vayamos acostumbrando a lo contrario, que tendremos que llevarnos bien en los próximos siglos.

Relacionado: